L’Europa è la prima al mondo a varare norme che regolano l’utilizzo dell’Intelligenza artificiale. L’intesa tra Commissione di Bruxelles, Parlamento di Strasburgo, Consiglio europeo dei capi di Stato e di Governo evidenzia la necessità di porre dei paletti allo sviluppo incontrollato della tecnologia. L’agenzia specializzata americana di cybersecurity Slash Nexen ha calcolato che nell’ultimo anno i raggiri tramite posta elettronica sono aumentati del 1.270 per cento. In sostanza, gli hacker usano con l’Ai un potente strumento con cui agire per “carpire” le informazioni utili a successive operazioni personalizzate di vario tipo. Dopo due anni di analisi, ricerche e confronti politici ed economici i vertici europei hanno raggiunto l’accordo su una piattaforma che sarà perfezionata nei prossimi mesi, per essere poi varata definitivamente prima delle elezioni di giugno. L’Europa del mercato unico e aperto più grande del mondo ha accelerato ni tempi del progetto regolatorio partito nel 2021, anche per non restare indietro alle innovazioni in materia raggiunte dagli Stati Uniti e dalla Cina. Il nuovo certo non si può arrestare o demonizzare, ma i prodotti delle tecnologie avanzate possono essere sottoposti a regolamenti per proteggere i cittadini, senza frenare lo sviluppo che interessa particolarmente alle aziende.

Raggiungere l’equilibrio tra interessi contrapposti non è mai facile e i vertici delle istituzioni europee hanno messo in campo esperti del diritto, dell’economia, della cultura per trovare soluzioni capaci di regolare i mercati, le attività creative e in sostanza la vita sociale. Le maggiori difficoltà incontrate nei negoziati di Bruxelles hanno riguardato gli ambiti dei diritti civili, dell’educazione, di alcuni settori medici (riconoscimento dei volti durante le manifestazioni sportive o culturali) e quelli legati alla sicurezza (ordine pubblico e difesa militare). C’è quindi ancora bisogno di riflettere sugli effetti della tecnologia dell’intelligenza artificiale. Ci si è posti anche il problema relativo alla giustizia: può l’Intelligenza artificiale decidere le sorti di un processo? Può un algoritmo quantificare le pene o i risarcimenti danni? In poco tempo l’Ai è diventata una realtà. Bisogna allora governare il cambiamento, studiarlo e capire quali sistemi utilizzare.

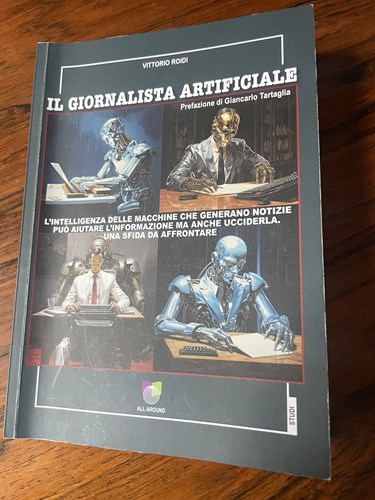

La qualità e la sicurezza dei dati e il loro costante aggiornamento costituiscono per i professionisti la base per la conoscenza del linguaggio delle macchine. La sfida non è tenere fuori dal nostro orizzonte l’utilizzo dell’Ai ma assicurarsi che sia finalizzata a creare valore aggiunto per le aziende (senza concorrenza sleale) e a garantire ai cittadini e ai lettori di giornali l’equità e la trasparenza del suo trattamento. Due, quindi i paletti: etica e sicurezza. Gli Usa sono molto avanti con ChatGpt di OpenAi e Google Bard che ha lanciato il modello Gemini per battere Microsoft. In Italia, la Federazione della stampa e la Fieg e altre 34 associazioni hanno firmato un appello al Governo Meloni chiedendo di “sostenere una regolamentazione equilibrata che, garantendo la trasparenza delle fonti, favorisca lo sviluppo delle tecnologie di intelligenza artificiale, tutelando e promuovendo al contempo creatività umana originale e tutti i contenuti culturali del Paese”. È sempre doveroso informare quando si utilizza l’Intelligenza artificiale. Per i giornalisti sono arrivate preziose linee guida elaborate in un libro (prefazione di Giancarlo Tartaglia) dell’ex presidente della Fnsi e segretario dell’Ordine Vittorio Roidi, giornalista di punta per anni del Messaggero.

(*) Il giornalista artificiale di Vittorio Roidi, prefazione di Giancarlo Tartaglia, All Around 2024, 160 pagine, 15 euro

Aggiornato il 13 dicembre 2023 alle ore 12:37